選挙の季節が近づくと、私たちのスマートフォンの画面は「怒り」と「熱狂」で埋め尽くされます。

YouTubeを開けば、特定の候補者が政敵を激しい言葉で論破するサムネイルが表示されます。

TikTokをスクロールすれば、誰かが失言をしている(ように見える)瞬間が、軽快なBGMと共に流れてきます。

「また政治の話か」とうんざりしつつも、強烈なタイトルに惹かれてついタップしてしまう。そして気づけば、数十分、あるいは数時間、似たような動画を見続けてしまっている・・・

もしあなたがこのような経験をしているなら、それはあなたの意思が弱いからではありません。

あなたの脳が、そのように反応するように精巧に「設計」されたコンテンツを見せられているからです。

現代の選挙戦において、街頭演説以上に有権者の心理に影響を与えているのが「切り抜き動画(Kirinuki)」です。

しかし、その多くは「事実を公平に伝えること」よりも、「再生数を稼ぎ、広告収益や知名度を得ること」に特化して作られています。

そこには、映像編集技術と認知心理学を悪用した、高度なトラップが仕掛けられています。

本記事では、選挙前に急増する政治系切り抜き動画が駆使する「3つの編集トリック」と、それによって私たちの脳内で起きている「ハッキングの仕組み」を、メディア論と心理学の観点から徹底解剖します。

特定の支持政党に関わらず、情報社会を生きるすべての有権者が知っておくべき「デジタルの防衛術」です。

まず、動画の具体的な手口に入る前に、その背景にある「経済的な構造」を理解する必要があります。

なぜ、これほどまでに攻撃的で、対立を煽るような動画が選挙前に量産されるのでしょうか。

答えはシンプルです。「政治的な怒り」が、ネット上で最も効率よくお金になるコンテンツだからです。

📊 SNSで拡散されやすい感情のヒエラルキー

※上に行くほど(幅が広いほど)、SNSのアルゴリズム上で優先的に表示されやすい傾向がある。

Webマーケティングの世界において、人間の感情の中で最も「クリック率(CTR)」と「反応率(エンゲージメント)」が高いのは、「感動」や「喜び」ではなく、「怒り」と「不安」であることが数々の研究で明らかになっています。

「許せない」「このままでは日本が危ない」「とんでもない発言だ」―こうした負の感情は、人間の生存本能に直結するため、脳はそれを無視することができません。

プラットフォーム側(YouTubeやXなど)のアルゴリズムは、「ユーザーを長くサイトに滞在させること」を最優先します。

その結果、「怒りを誘発するコンテンツ」ほど優先的に拡散される仕組みが出来上がっています。これを「アテンション・エコノミー(関心経済)」と呼びます。

現在、多くの政治系YouTuberや候補者が、第三者による「切り抜き」を許可(黙認または公認)しています。

ここで重要なのは、動画を作っている「キリヌキ師」たちの多くは、必ずしもその政治家の熱烈な思想的・政治的支持者ではないという事実です。

彼らの多くは、再生数に応じた収益を得ることを目的としたビジネスプレイヤーです。

ビジネスである以上、彼らが優先するのは「正確な政策の解説」ではありません。

「いかにサムネイルをクリックさせるか」「いかに最後まで見させるか」です。

そのために、彼らはプロの編集技術を駆使して、退屈な国会答弁や街頭演説を、刺激的なエンターテインメントへと加工します。

私たちは「政治情報」を摂取しているつもりで、実は「換金されるために加工された感情刺激」を消費させられているのです。

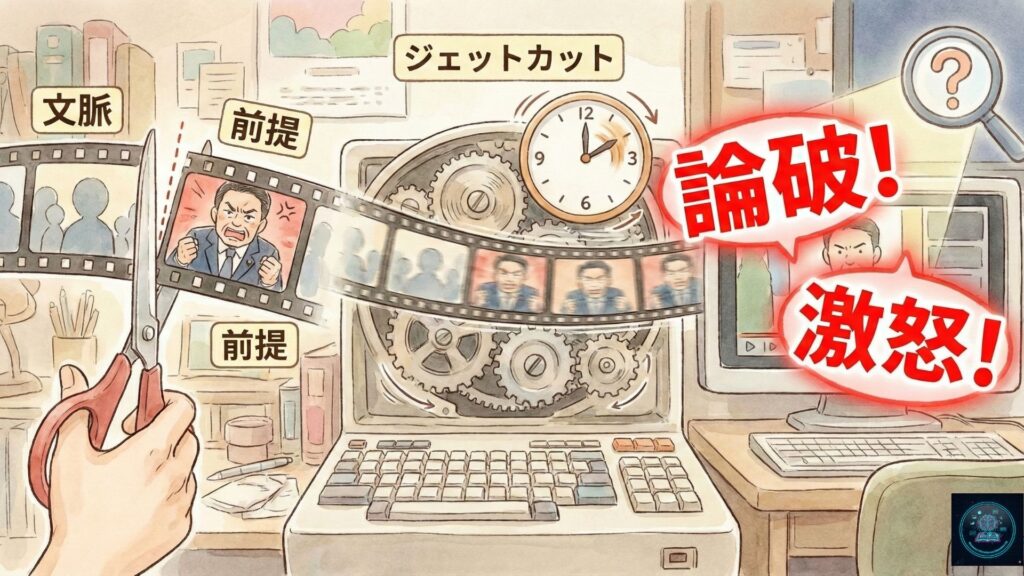

では、具体的にどのような手法で私たちの印象は操作されているのでしょうか。

プロの編集者が使うテクニックは、一見すると「わかりやすく要約してくれている」ように見えますが、そこには視聴者の認知を歪める意図的なバイアスが潜んでいます。代表的な3つのトリックを解剖します。

最も古典的かつ強力なのが「文脈(コンテキスト)の消去」です。

1時間の演説を1分のショート動画にする際、前後の文脈を切り落とすことで、発言の意味を180度変えてしまうことが可能です。

例えば、ある政治家が以下のように発言したとします。

「Aという極端な政策には、一部で景気を刺激するというメリットがあると言われています。しかし、財源不足や格差拡大という深刻な副作用を考慮すると、現時点での導入は危険であり、私は断固として反対です」

この発言を切り抜く際、前半の「Aという政策にはメリットがあると言われています」の部分だけを残し、後半の否定部分をカットしたらどうなるでしょうか?

その政治家は一瞬にして「危険なA政策の推進派」に見えてしまいます。

逆に、後半の「反対です」という強い言葉だけを切り取り、何に反対しているかの主語を曖昧にすれば、「なんでも反対する野党議員」という印象操作も可能です。

これは論理学で言う「ストローマン(藁人形)論法」になります。

相手の主張を歪めて引用し、叩きやすい架空の論敵を作り出す手法を、映像編集によって強制的に作り出すテクニックです。

視聴者は「切り取られていない部分」を見ることはできないため、提示された映像を事実として受け入れるしかありません。

YouTubeやTikTokで主流の編集技法に「ジェットカット(ジャンプカット)」があります。

話者の「えー」「あー」というフィラー(言い淀み)や、息継ぎ、思考するための「沈黙」を徹底的に削除し、言葉と言葉を間髪入れずに繋ぐ手法です。

テンポが良く、見ていて気持ちが良いこの編集には、重大な副作用があります。

それは、「視聴者が考える時間を奪う」ことです。

情報の密度が極限まで高められたジェットカット動画を見ているとき、私たちの脳は入ってくる情報を処理することに手一杯になります。

その結果、批判的思考を司る「システム2」が起動する隙を与えられず、直感的な「システム1」だけで情報を飲み込んでしまいます。

結果として、早口でまくし立てる動画ほど、「頭の回転が速い」「論理的だ」「圧倒している」という錯覚を与えます。

内容の正誤に関わらず、編集のテンポが生み出す「リズム」に説得されてしまうのです。

動画の内容を見る前に、サムネイルや冒頭の巨大なテロップで「論破」「激怒」「放送事故」「完全勝利」といった強い言葉を見たことはありませんか?

これは心理学でいう「プライミング効果(先行刺激)」の悪用です。

事前に「この政治家は怒っている」「この相手は負けた」という情報をテロップで刷り込まれると、脳はその先入観(フレーム)に沿って映像を解釈しようとします。

普通のトーンで議論をしているだけのシーンでも、画面が揺れ、効果音が鳴り、赤と黒の極太フォントで「完全論破!」と表示されれば、視聴者は「ああ、これは論破したんだな」と認識します。

テロップは単なる字幕ではありません。

「ここで笑え」「ここで怒れ」「こいつを敵だと思え」という、編集者からの「感情の指示書」なのです。

私たちは動画を見ているようで、実はテロップという指示書を読まされているに過ぎません。

| 編集トリック | 手法(How) | 脳への副作用(Effect) |

|---|---|---|

|

① 文脈の切断 (ストローマン論法) |

前後の文脈や「前提条件」をカットし、過激な発言だけを繋ぎ合わせる。 | 本来の意図とは逆の印象を持たせ、「敵」か「味方」かの二元論に落とし込む。 |

|

② ジェットカット (思考停止の誘発) |

「えー」「あー」や沈黙を全カットし、0.1秒の間もなく言葉を詰め込む。 | 脳の処理能力をオーバーさせ、批判的に考える時間(システム2)を奪う。 |

|

③ 視覚的プライミング (感情の強制) |

サムネイルやテロップで「論破」「激怒」などの強い言葉を先行して見せる。 | 内容を見る前に「これはスカッとする動画だ」という先入観(フレーム)を植え付ける。 |

なぜ私たちは、これほど簡単なトリックにこうも簡単に引っかかってしまうのでしょうか。

それは、SNSのアルゴリズムと人間の脳の相性が「良すぎる」からです。

テクノロジーは私たちの脳のバグ(認知バイアス)を突くように進化してきました。

自分と異なる意見を聞くことは、脳にとってストレスです。

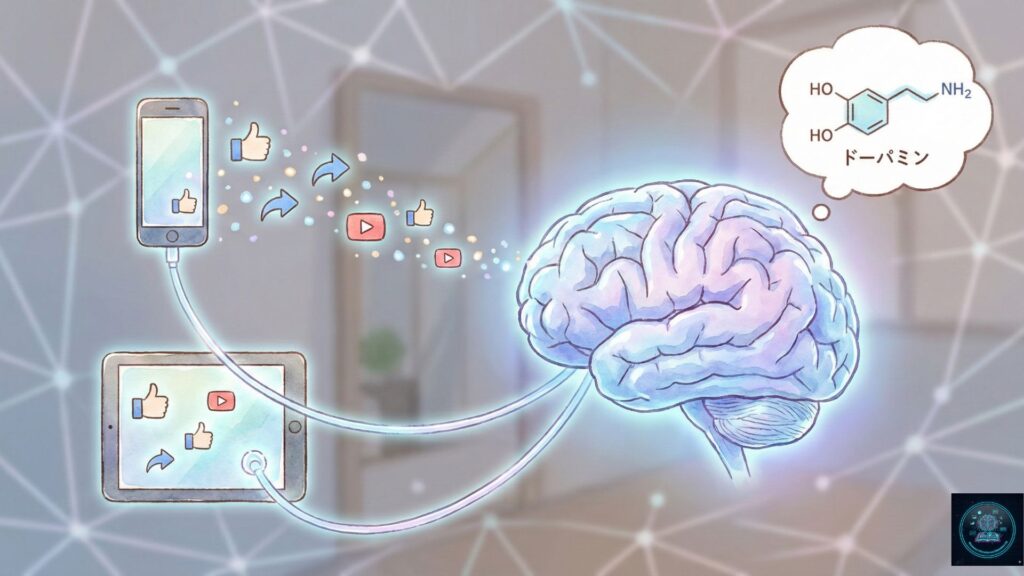

エネルギーを使いますし、不快です。 一方で、自分の考えを肯定してくれる意見や、嫌いな相手がやり込められている姿を見ることは、脳の報酬系を刺激し、快楽物質であるドーパミンを分泌させます。

人は無意識に「自分の信じたい情報を探し、信じたくない情報を無視する」習性があります。

アルゴリズムはこの習性を熟知しています。

あなたが一度でも「A候補がB候補を批判する動画」を好んで見れば(長く再生すれば)、AIは「あなたはこれを好む」と学習し、次々と似たような動画をおすすめします。

それは情報の取得ではなく、「自分の正しさを再確認するための快楽摂取」という娯楽(エンタメ)になってしまっているのです。

こうして、あなたのタイムラインは「自分と同じ意見」や「敵を攻撃する動画」だけで埋め尽くされます。

四方を鏡に囲まれた部屋(エコーチェンバー)にいるようなもので、そこでは自分の声が反響し増幅されます。

さらに恐ろしいのが、コメント欄です。

その動画に集まるのは、アルゴリズムによって選別された「似た思想を持つ人たち」だけです。

コメント欄には「その通りだ」「よく言った」という称賛が並びます。

これを見ると、脳は「世の中のみんながこう言っている」「これが国民の総意だ」と錯覚します。これを「多数派の錯覚」と呼びます。

しかし、一歩そのチャンネルの外に出れば、全く逆の意見を持つ人々のエコーチェンバーが存在しています。

選挙期間中、ネット上で話が全く通じない分断が起きるのは、互いに見ている「現実」が、アルゴリズムによって全く別のものに書き換えられているからです。

▼ 記事で紹介した「脳のバグ」をもっと深く知りたい方へ

本記事で解説した「システム1・システム2」の理論は、ノーベル賞学者ダニエル・カーネマンの著書『ファスト&スロー』で詳しく解説されています。 「なぜ人は騙されるのか?」という人間の心理的なバグを体系的に学びたい方は、選挙前に一度読んでおくことをおすすめします。

ここまで、切り抜き動画の構造と脳への影響を見てきました。

しかし、誤解しないでいただきたいのは、テクノロジーや動画編集自体が悪なのではないということです。問題なのは、私たちがその「仕組み」を知らずに、無防備に情報を浴びてしまうことです。

最後に、今日からできる具体的な防衛策を3つ提案します。これを行うだけで、情報をあなたの手に取り戻すことができます。

動画を見て「スカッとした」「ムカついた」「許せない」と強い感情が湧いた瞬間こそ、最大の警戒警報です。

その感情は、動画の制作者が「意図的に引き出したもの」である可能性が高いからです。

「今、自分は怒らされているのではないか?」と自問してください。

シェアボタンやいいねボタンを押す前に、スマホを置いて深呼吸する。

これだけで、ドーパミンによる衝動的な拡散を防げます。感情的になっている時のシェアは、大抵の場合、後で後悔することになります。

「〇〇と言われている」「裏では××らしい」といった、主語が曖昧な情報が動画に含まれていたら要注意です。

また、切り抜き動画で気になった発言があれば、必ず「一次情報」に当たる癖をつけましょう。

現代では、Google検索やYouTube検索で「候補者名 政策 フル動画」と検索すれば、編集されていないオリジナルの動画や、公式サイトの記述に簡単に辿り着けます。

「あの切り抜き、実は前後にこんな文脈があったのか」と気づくには、わずか5分の確認作業で十分です。たった5分で、誰かの養分になることを防げます。

アルゴリズムによるエコーチェンバーを打破する唯一の方法は、能動的に検索すること(指名検索)です。

普段見ない政党、苦手な評論家、反対意見を持つメディアの動画を、あえて検索して1つ再生してみてください。

「彼らはなぜそう考えるのか?」という視点を持つことで、AIの学習に意図的なノイズを混ぜ、おすすめの偏りを補正することができます。

これは「敵を知る」という意味でも有効な戦略ですし、何より自分の思考のバランスを保つためのトレーニングになります。

選挙とは、私たちの未来を決める重要な意思決定の場です。

その判断材料を、誰かが収益目的で編集し、着色し、切り取った「1分間の動画」だけに委ねるのは、あまりにもリスクが高い行為と言わざるを得ません。

切り抜き動画は、あくまで入り口であり、エンターテインメントです。

その裏にある編集の意図を見抜き、情報の「成分表示」を確認するリテラシーを持つこと。 画面の向こうにある「真実」は、おすすめフィードの外側にしか落ちていません。

その動画、本当に「あなたの意見」ですか? それとも「作られた意見」ですか?

投票用紙に名前を書くその瞬間、あなたの手が、あなた自身の意思で動いていることを願っています。

🛡️ デジタル・デモクラシーを守る「視聴前」チェックリスト

| チェック項目 | 具体的なアクション |

|---|---|

| □ 感情が揺さぶられたか? | 「ムカついた」「スカッとした」と感じたら、シェアする前に一度スマホを置く。 |

| □ 主語は明確か? | 「~と言われている」「~らしい」という曖昧なソースではないか確認する。 |

| □ 編集されていないか? | 発言の一部が不自然にカットされていないか、前後を確認する。 |

| □ 1分で判断していないか? | ショート動画は「予告編」に過ぎない。「本編(一次情報)」を検索する癖をつける。 |

| □ 「嫌いな人」も見ているか? | おすすめ欄が「好きな意見」だけで埋まらないよう、あえて反対意見も検索して見る。 |

『スマホ脳』(アンデシュ・ハンセン 著 / 新潮新書)

「私たちはスマホを使っているのではない。スマホに使われているのだ」

記事の第3章で触れた「ドーパミン」や「報酬系」の仕組みについて、これほど残酷かつ明快に解説した本はありません。 なぜ私たちは通知が来ると無視できないのか? なぜ不安を煽る情報ばかり見てしまうのか? 世界的ベストセラーとなった本書は、それがあなたの意思の弱さではなく、脳の生物学的なメカニズム(仕様)であることを教えてくれます。敵の手口を知るための、現代人の必読書です。べき一冊です。